Data Pipeline (hay còn gọi là đường dẫn dữ liệu) là hệ thống cho phép dữ liệu thô được thu thập từ nhiều nguồn khác nhau, sau đó được chuyển đổi, làm sạch và chuẩn hóa, trước khi đưa vào kho lưu trữ để phục vụ phân tích, trực quan hóa hay huấn luyện mô hình AI. Hiện nay, có hai loại Data Pipeline phổ biến nhất mà doanh nghiệp thường sử dụng: Batch Processing (xử lý theo lô) và Streaming Data (xử lý theo luồng). Mỗi loại có ưu – nhược điểm riêng, tùy theo nhu cầu phân tích dữ liệu.

I. Data Pipeline là gì?

Data Pipeline (hay còn gọi là đường dẫn dữ liệu) là hệ thống cho phép dữ liệu thô được thu thập từ nhiều nguồn khác nhau, sau đó được chuyển đổi, làm sạch và chuẩn hóa, trước khi đưa vào kho lưu trữ để phục vụ phân tích, trực quan hóa hay huấn luyện mô hình AI.

Nói cách khác, Data Pipeline giống như một dây chuyền sản xuất dữ liệu:

- Nguyên liệu đầu vào là dữ liệu thô (từ CRM, ERP, API, IoT, khảo sát khách hàng…).

- Trong quá trình vận hành, dữ liệu sẽ được xử lý (lọc, gộp, chuyển đổi định dạng, chuẩn hóa).

- Thành phẩm cuối cùng là dữ liệu “sạch” sẵn sàng để phân tích, tạo báo cáo KPI,… Hoặc đưa vào các mô hình học máy.

Ví dụ thực tế trong kinh doanh:

Tại doanh nghiệp FMCG như Vinamilk, dữ liệu được sinh ra từ hệ thống ERP quản lý chuỗi cung ứng. Từ CRM ghi nhận tương tác khách hàng, và cả khảo sát phản hồi thị trường. Nếu không có Data Pipeline, các nguồn dữ liệu này sẽ rời rạc, khó phân tích. Nhờ pipeline, toàn bộ dữ liệu được gom lại, làm sạch và đưa vào Data Warehouse. Từ đó các nhà quản lý có thể theo dõi doanh số theo khu vực, mức tồn kho, và hành vi tiêu dùng trên dashboard. Đây chính là cách pipeline biến dữ liệu thô thành insight phục vụ quyết định kinh doanh.

Hiểu rõ Data Pipeline là nền tảng đầu tiên để học các công cụ phân tích dữ liệu như SQL, Power BI, hay Excel. Bởi vì bạn cần biết dữ liệu đến từ đâu, được xử lý như thế nào. Trước khi bắt tay vào trực quan hóa và phân tích.

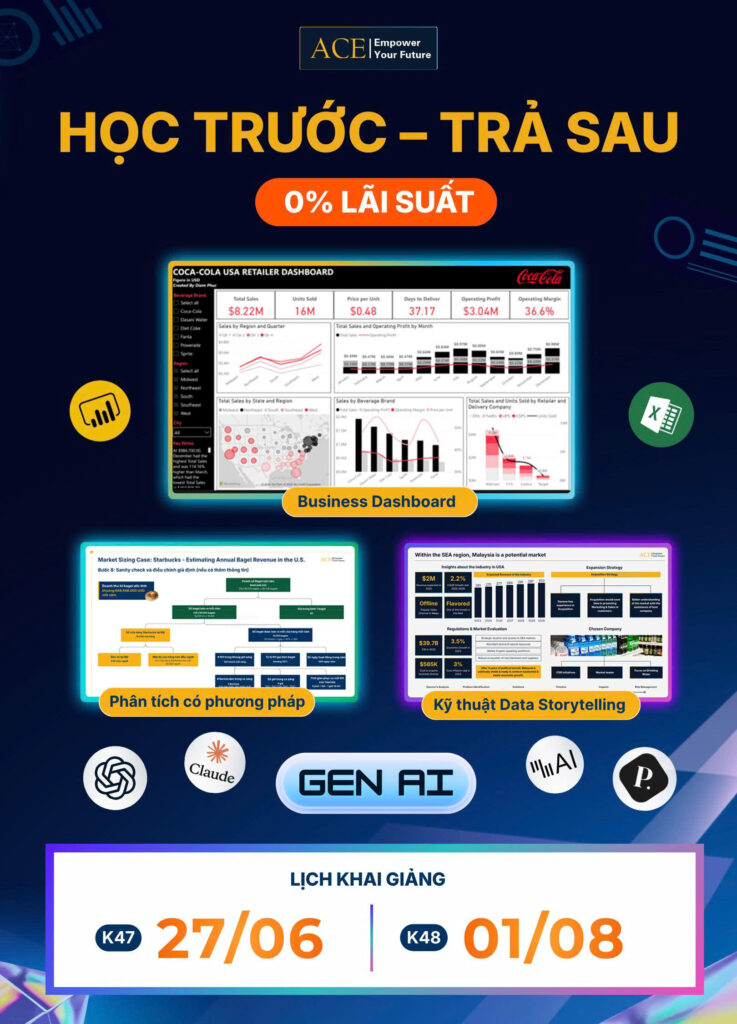

Nếu bạn đang là newbie và chưa biết bắt đầu từ đâu, hãy tham khảo ngay khóa học phân tích dữ liệu kinh doanh – Data Analysis For Business Professionals tại ACE Academy. Excel và Power BI hiện đang là 2 công cụ phổ biến hàng đầu được các doanh nghiệp lớn sử dụng. Và khóa học tại ACE sẽ hỗ trợ bạn toàn bộ kĩ năng cần thiết cho 2 công cụ này.

II. Các loại Data Pipeline

Hiện nay, có hai loại Data Pipeline phổ biến nhất mà doanh nghiệp thường sử dụng: Batch Processing (xử lý theo lô) và Streaming Data (xử lý theo luồng). Mỗi loại có ưu – nhược điểm riêng, tùy theo nhu cầu phân tích dữ liệu.

1. Batch Processing – Xử lý theo lô

Batch Processing là hình thức thu thập dữ liệu trong một khoảng thời gian nhất định. Sau đó xử lý toàn bộ dữ liệu đó theo từng “lô” (batch).

- Đặc điểm: dữ liệu không cần xử lý ngay lập tức. Nó có thể đợi đến cuối ngày, cuối tuần hoặc cuối tháng.

- Ưu điểm: ổn định, độ chính xác cao, thích hợp với dữ liệu lớn.

- Nhược điểm: không phù hợp khi doanh nghiệp cần dữ liệu thời gian thực.

Ví dụ: Cuối mỗi tháng, Vinamilk tổng hợp dữ liệu bán hàng từ hàng ngàn điểm phân phối trên toàn quốc. Pipeline sẽ gom toàn bộ dữ liệu này, chuẩn hóa, rồi lưu vào Data Warehouse để bộ phận Tài chính lập báo cáo doanh số hàng tháng.

2. Streaming Data – Xử lý theo luồng

Streaming Data là hình thức xử lý dữ liệu ngay khi nó được tạo ra, gần như real-time.

- Đặc điểm: dữ liệu liên tục chảy vào hệ thống và được xử lý ngay lập tức.

- Ưu điểm: cung cấp insight tức thời, hữu ích cho vận hành thời gian thực.

- Nhược điểm: độ phức tạp cao hơn, chi phí hệ thống lớn hơn. Có thể xảy ra mất mát dữ liệu nếu không thiết kế tốt.

Ví dụ: Trong các kho lạnh bảo quản sữa tươi, Vinamilk lắp đặt IoT sensors để đo nhiệt độ và độ ẩm. Dữ liệu được gửi liên tục về hệ thống. Nếu nhiệt độ vượt ngưỡng cho phép, pipeline sẽ cảnh báo ngay cho đội ngũ vận hành. Giúp giảm rủi ro hư hỏng hàng hóa.

Tìm hiểu sâu hơn về Data Pipeline, cách ứng dụng Data Pipeline vào Business Case? Tham khảo ngay khóa học Decision Analytics with Power BI tại ACE Academy để làm chủ mọi tác vụ Power BI chỉ sau 6 buổi

III. Kiến trúc Data Pipeline (Data Pipeline Architecture)

Một Data Pipeline thường được thiết kế theo 3 bước chính: Nhập dữ liệu – Chuyển đổi dữ liệu – Lưu trữ dữ liệu. Hiểu được kiến trúc này giúp bạn hình dung toàn bộ vòng đời dữ liệu. Từ lúc được sinh ra cho đến khi sẵn sàng phục vụ phân tích và ra quyết định.

1. Nhập dữ liệu (Data Ingestion)

Data Ingestion là bước đầu tiên trong một Data Pipeline. Nơi dữ liệu thô được “hút” từ nhiều nguồn khác nhau và đưa vào hệ thống. Đây giống như giai đoạn “gom nguyên liệu” trong một dây chuyền sản xuất: muốn có sản phẩm cuối cùng chất lượng, nguyên liệu đầu vào phải đầy đủ và được thu thập đúng cách.

Trong doanh nghiệp, dữ liệu có thể đến từ nhiều nguồn:

- Nguồn nội bộ (Internal Data Sources): Bao gồm những hệ thống vận hành sẵn có như CRM (Customer Relationship Management), ERP (Enterprise Resource Planning), hệ thống bán hàng POS, hoặc dữ liệu tài chính. Đây là các nguồn dữ liệu “xương sống” của doanh nghiệp. Vì chúng phản ánh trực tiếp hoạt động kinh doanh hàng ngày.

- Nguồn bên ngoài (External Data Sources): Doanh nghiệp thường kết nối thêm với dữ liệu từ bên ngoài để có bức tranh toàn diện hơn. Ví dụ: dữ liệu từ Google Analytics để theo dõi hành vi khách hàng online. Dữ liệu thời tiết từ OpenWeather để dự đoán nhu cầu sản phẩm theo mùa. Hay dữ liệu thị trường – mạng xã hội để phân tích xu hướng tiêu dùng.

- Nguồn IoT & Machine Logs (Machine-Generated Data): Trong ngành sản xuất hoặc logistics, máy móc và thiết bị IoT liên tục sinh ra dữ liệu: cảm biến đo nhiệt độ, độ ẩm trong kho, dữ liệu từ dây chuyền sản xuất, hoặc log server của hệ thống CNTT. Đây là dạng dữ liệu có khối lượng rất lớn và được cập nhật liên tục.

- Nguồn khảo sát con người (Human-Generated Data): Bên cạnh dữ liệu máy móc, doanh nghiệp còn cần dữ liệu “định tính” từ con người: phản hồi khách hàng qua call center, survey online, biểu mẫu đăng ký,… Hay thậm chí là email góp ý. Đây là nguồn dữ liệu giàu insight, giúp bổ sung cho dữ liệu vận hành.

Ví dụ thực tế:

Tại Vinamilk, dữ liệu bán hàng từ ERP ghi nhận lượng hàng phân phối mỗi ngày. Dữ liệu khảo sát khách hàng phản ánh mức độ hài lòng về sản phẩm. Và dữ liệu IoT từ kho lạnh đo nhiệt độ bảo quản sữa. Tất cả các nguồn này đều được pipeline thu thập về một hệ thống trung tâm. Việc này đảm bảo khi phân tích, công ty có thể nhìn vào bức tranh đầy đủ và đồng nhất. Chính là doanh số thực tế, phản hồi người tiêu dùng, và dữ liệu vận hành kho lạnh.

Có thể thấy, bước nhập dữ liệu không chỉ đơn thuần là “gom dữ liệu về”, mà là gom đủ – gom đúng – gom kịp thời. Nếu ngay từ đầu dữ liệu bị thiếu hoặc chậm trễ, toàn bộ pipeline phía sau sẽ bị ảnh hưởng. Dẫn đến báo cáo sai hoặc quyết định chậm trễ.

2. Chuyển đổi dữ liệu (Data Transformation)

Sau khi được thu thập, dữ liệu thô thường không thể phân tích ngay vì nó có thể chứa lỗi, bị trùng lặp, thiếu chuẩn hóa hoặc định dạng không đồng nhất. Vì vậy, bước Data Transformation giống như giai đoạn “chế biến nguyên liệu” trong dây chuyền sản xuất: dữ liệu được làm sạch, chuẩn hóa và biến đổi thành dạng mà hệ thống phân tích có thể hiểu và sử dụng.

Hai mô hình xử lý dữ liệu chính:

- ETL (Extract – Transform – Load)

- Dữ liệu được trích xuất từ nhiều nguồn (ERP, CRM, API).

- Sau đó được biến đổi và làm sạch: loại bỏ dữ liệu lỗi, chuẩn hóa đơn vị đo lường, mã hóa dữ liệu nhạy cảm, gộp bảng.

- Cuối cùng, dữ liệu đã sạch được nạp vào Data Warehouse. Nơi lưu trữ có cấu trúc, phục vụ trực tiếp cho phân tích và báo cáo.

- Mô hình ETL phù hợp khi dữ liệu cần được chuẩn hóa kỹ lưỡng trước khi dùng cho báo cáo chiến lược. Ví dụ: báo cáo tài chính, báo cáo KPI hàng tháng.

- ELT (Extract – Load – Transform)

- Dữ liệu được trích xuất từ nguồn.

- Được nạp thẳng vào Data Lak (nơi có thể lưu trữ dữ liệu khổng lồ, kể cả phi cấu trúc như log server, dữ liệu IoT, dữ liệu mạng xã hội).

- Sau đó mới được xử lý/biến đổi khi cần để phục vụ cho các mục đích khác nhau. Chẳng hạn huấn luyện mô hình AI hay phân tích dữ liệu lớn.

- ELT phù hợp khi doanh nghiệp muốn lưu trữ toàn bộ dữ liệu thô để linh hoạt sử dụng sau này. Đặc biệt trong môi trường Big Data.

Các thao tác phổ biến trong Data Transformation:

- Loại bỏ giá trị trùng lặp (Remove Duplicates): tránh việc một khách hàng xuất hiện nhiều lần với thông tin khác nhau.

- Chuẩn hóa định dạng ngày tháng: từ nhiều kiểu khác nhau (dd/mm/yyyy, mm-dd-yyyy) về một chuẩn thống nhất.

- Gộp nhiều bảng (Merge/Join): kết hợp dữ liệu từ nhiều nguồn. Ví dụ gộp thông tin khách hàng từ CRM với lịch sử giao dịch từ ERP.

- Ẩn/mã hóa dữ liệu nhạy cảm (Data Masking): bảo vệ thông tin cá nhân như số điện thoại, email, số thẻ tín dụng.

- Tạo trường mới (Derived/Calculated Fields): ví dụ tính “Doanh thu = Số lượng × Đơn giá”.

- Chuẩn hóa đơn vị đo lường: ví dụ đổi tất cả trọng lượng về “kg” thay vì có nơi nhập “g” hoặc “lbs”.

Ví dụ thực tế:

Trong hệ thống CRM của Vinamilk, tên khách hàng có thể được lưu ở nhiều định dạng khác nhau: “Nguyen Van A”, “Nguyễn V. A.”,… Hoặc chỉ “Anh Nguyễn”. Nếu dữ liệu này được dùng trực tiếp, pipeline sẽ không thể nhận diện đây là cùng một khách hàng.

Nhờ bước Data Transformation, toàn bộ thông tin sẽ được chuẩn hóa về một định dạng duy nhất. Ví dụ: “Nguyễn Văn A”. Sau đó, pipeline gộp dữ liệu này với dữ liệu ERP (lịch sử mua hàng, khu vực phân phối) để phân tích hành vi khách hàng theo vùng miền.

Kết quả: nhà quản lý không chỉ thấy doanh số chung, mà còn biết được khách hàng nào đang mua nhiều nhất, ở đâu, và xu hướng tiêu dùng ra sao.

Data Transformation chính là cầu nối giữa dữ liệu thô và dữ liệu có giá trị. Nếu bỏ qua hoặc làm chưa tốt bước này, phân tích dữ liệu sau đó sẽ thiếu chính xác. Dẫn đến quyết định kinh doanh sai lệch.

3. Lưu trữ dữ liệu (Data Storage)

Sau khi đi qua bước làm sạch và chuẩn hóa, dữ liệu cần được đưa vào một nơi lưu trữ tập trung để có thể khai thác lâu dài cho báo cáo, phân tích và AI. Đây là “kho thành phẩm” trong dây chuyền dữ liệu. Là nơi quyết định dữ liệu có thể phục vụ đúng nhu cầu kinh doanh hay không.

Trong doanh nghiệp hiện nay, có bốn mô hình lưu trữ phổ biến:

3.1 Data Warehouse (Kho dữ liệu tập trung)

- Đặc điểm:

- Lưu trữ dữ liệu có cấu trúc rõ ràng (bảng, cột, chỉ mục).

- Tập trung vào dữ liệu đã qua xử lý, đảm bảo sạch, thống nhất và ổn định.

- Tối ưu cho truy vấn nhanh và phục vụ phân tích kinh doanh.

- Ứng dụng:

- Tạo báo cáo KPI, dashboard quản trị, phân tích xu hướng kinh doanh.

- Ví dụ: Vinamilk lưu toàn bộ dữ liệu bán hàng đã chuẩn hóa vào Data Warehouse. Từ đó đội ngũ Tài chính và Kinh doanh có thể tạo báo cáo doanh số, lợi nhuận gộp và hiệu suất phân phối.

3.2 Data Mart (Kho dữ liệu theo phòng ban)

- Đặc điểm:

- Là “nhánh nhỏ” của Data Warehouse. Được thiết kế cho nhu cầu phân tích riêng của từng bộ phận.

- Ví dụ: Marketing cần phân tích dữ liệu khách hàng. Tài chính cần phân tích chi phí và doanh thu. Nhân sự cần phân tích dữ liệu nhân viên.

- Ứng dụng:

- Giúp từng phòng ban có dữ liệu “đúng nhu cầu”. Không cần truy xuất vào toàn bộ Warehouse.

- Ví dụ: Bộ phận Marketing của Vinamilk có Data Mart riêng để phân tích hiệu quả chiến dịch quảng cáo (dữ liệu CRM + dữ liệu bán hàng). Trong khi bộ phận Sản xuất có Data Mart phân tích hiệu suất dây chuyền và chi phí nguyên liệu.

3.3 Data Lake (Hồ dữ liệu lớn)

- Đặc điểm:

- Lưu trữ khối lượng dữ liệu khổng lồ. Bao gồm cả dữ liệu có cấu trúc, bán cấu trúc và phi cấu trúc (log server, ảnh, video, file JSON, dữ liệu IoT).

- Linh hoạt, không cần chuẩn hóa dữ liệu trước khi lưu.

- Ứng dụng:

- Phục vụ AI/ML, Big Data Analytics, hoặc phân tích dữ liệu nâng cao.

- Ví dụ: Vinamilk sử dụng Data Lake để lưu dữ liệu từ cảm biến IoT giám sát nhiệt độ kho lạnh, dữ liệu social media từ Facebook/Instagram, và cả dữ liệu survey chưa chuẩn hóa. Các dữ liệu này sau đó có thể dùng để huấn luyện mô hình AI dự đoán hành vi tiêu dùng.

3.4 Data Lakehouse (Mô hình kết hợp)

- Đặc điểm:

- Là sự kết hợp giữa Data Warehouse và Data Lake.

- Cho phép lưu trữ dữ liệu đa dạng như Data Lake. Nhưng vẫn đảm bảo khả năng truy vấn nhanh và tính ổn định như Data Warehouse.

- Ứng dụng:

- Trở thành mô hình ngày càng phổ biến trong các tập đoàn. Vì vừa phục vụ phân tích truyền thống (BI), vừa hỗ trợ AI/ML hiện đại.

- Ví dụ: Với Data Lakehouse, Vinamilk có thể vừa chạy báo cáo doanh số truyền thống, vừa tận dụng dữ liệu IoT và social media để phân tích nâng cao. Tất cả trong một hệ thống thống nhất.

Việc chọn mô hình lưu trữ nào phụ thuộc vào quy mô doanh nghiệp, mục tiêu phân tích và ngân sách đầu tư. Nhưng dù chọn cách nào, lưu trữ dữ liệu luôn là bước then chốt để pipeline thực sự tạo ra giá trị cho tổ chức.

IV. Ứng dụng của Data Pipeline trong doanh nghiệp

Data Pipeline không chỉ là “đường ống kỹ thuật” để vận chuyển dữ liệu. Nó chính là nền tảng giúp doanh nghiệp biến dữ liệu thô thành giá trị kinh doanh thực tiễn. Một pipeline được thiết kế tốt sẽ mở ra nhiều ứng dụng quan trọng:

1. Data Visualization & Khám phá dữ liệu (EDA)

Trước khi xây dựng mô hình phức tạp, các nhà phân tích dữ liệu thường bắt đầu bằng Exploratory Data Analysis (EDA). Tức là “khám phá” dữ liệu để hiểu bản chất, tìm ra pattern, và phát hiện bất thường. EDA chỉ có thể hiệu quả khi dữ liệu đã được pipeline xử lý và chuẩn hóa.

Cách hoạt động:

- Pipeline gom dữ liệu từ nhiều nguồn → cung cấp dataset sạch.

- Nhà phân tích dùng công cụ visualization (Power BI, Tableau, Python matplotlib/seaborn) để trực quan hóa.

- Từ đó, họ có thể kiểm tra giả thuyết, phát hiện outlier, và tìm insight ban đầu.

Ứng dụng:

- Phát hiện xu hướng tiêu dùng theo mùa vụ.

- Kiểm tra dữ liệu trước khi đưa vào mô hình Machine Learning.

- Hỗ trợ các nhà quản lý ra quyết định nhanh dựa trên insight ban đầu.

Ví dụ thực tế:

Sau khi pipeline làm sạch dữ liệu bán hàng theo vùng, EDA cho thấy ở miền Trung, sản phẩm sữa chua uống tăng trưởng mạnh vào mùa hè. Insight này gợi ý cho Vinamilk triển khai chiến dịch marketing mùa vụ, tập trung khuyến mãi và phân phối nhiều hơn tại khu vực này.

Nhờ pipeline, EDA trở thành một công cụ mạnh mẽ giúp doanh nghiệp hiểu nhanh dữ liệu và nắm bắt cơ hội kinh doanh. Thay vì bị lạc trong dữ liệu rời rạc và thiếu chuẩn hóa.

Để có đầy đủ kĩ năng về làm sạch, xử lý và hiểu rõ insight của dữ liệu, tham khảo ngay khóa học Data Analysis For Business Professionals tại ACE Academy. Khóa học với chương trình được thiết kế tinh gọn từ các chuyên gia đầu ngành sẽ giúp bạn xử lí được mọi bài toán kinh doanh chỉ sau vài buổi học đầu tiên

2. Business Intelligence (BI) & Báo cáo quản trị

Các công cụ BI như Power BI, Tableau, Qlik Sense chỉ phát huy hết sức mạnh khi có dữ liệu sạch, đồng bộ và được chuẩn hóa từ pipeline. Nhờ đó, báo cáo trực quan và dashboard không còn bị sai lệch do dữ liệu trùng lặp, thiếu định dạng hoặc không nhất quán.

Ban lãnh đạo có thể theo dõi KPI theo thời gian thực, so sánh hiệu quả bán hàng giữa các khu vực, hoặc phát hiện sớm những vấn đề bất thường trong chuỗi cung ứng.

Ví dụ thực tế:

Pipeline gom dữ liệu từ ERP (doanh số, tồn kho) và CRM (thông tin khách hàng) → Power BI xây dựng dashboard hiển thị doanh số sữa tươi theo khu vực, so sánh với tăng trưởng sữa bột cùng kỳ năm trước. Quản lý có thể nhanh chóng nhận diện thị trường nào đang tăng trưởng tốt, thị trường nào cần đẩy mạnh marketing hoặc khuyến mãi.

Đây là giá trị cốt lõi: từ dữ liệu thô → pipeline xử lý → dashboard trực quan → quyết định kinh doanh sáng suốt.

Tham khảo blog về Power BI để hiểu rõ hơn về công cụ cũng như các tính năng vượt trội của Power BI trong xử lý và trực quan hóa dữ liệu.

Nếu bạn là newbie và chưa biết phải bắt đầu từ đâu? Tham gia khóa học Decision Analytics With Power BI tại ACE Academy để làm chủ công cụ với mọi kỹ năng chuẩn chuyên gia chỉ với 6 buổi học. Khóa học không chỉ đào tạo kỹ năng Power BI chuyên sâu mà còn định hướng tư duy để giúp bạn hiểu sâu và triệt để cốt lõi của vấn đề. Dễ dàng xử lý mọi bài toán thực tế của doanh nghiệp.

3. Self-Service Analytics (Phân tích tự phục vụ)

Thay vì phụ thuộc vào phòng IT để truy xuất dữ liệu, các phòng ban có thể tự truy vấn Data Mart được pipeline chuẩn hóa sẵn. Điều này giúp nhân viên và nhà phân tích linh hoạt hơn trong công việc. Giảm “nút thắt cổ chai” ở IT, đồng thời tăng tốc độ ra quyết định.

Ứng dụng:

- Bộ phận Marketing có thể truy vấn dữ liệu khách hàng để phân tích hành vi tiêu dùng.

- Bộ phận Tài chính có thể lấy dữ liệu chi phí và doanh thu để tính toán biên lợi nhuận nhanh chóng.

- Bộ phận Nhân sự có thể phân tích tỷ lệ nghỉ việc hoặc hiệu suất làm việc theo phòng ban.

Ví dụ thực tế:

Bộ phận Marketing muốn đo lường hiệu quả chiến dịch quảng cáo Tết. Thay vì gửi yêu cầu cho IT, họ có thể trực tiếp truy cập Data Mart đã được pipeline làm sạch để so sánh:

- Doanh số trước – trong – sau Tết.

- Phân tích khu vực nào phản hồi tốt với quảng cáo.

- Đối chiếu với dữ liệu social media để hiểu mức độ lan tỏa chiến dịch.

Với Self-Service Analytics, pipeline chính là “người gác cổng” đảm bảo dữ liệu ai cũng dùng được, ai cũng tin tưởng được. Từ đó mọi phòng ban đều có thể phân tích mà không lo sai lệch.

4. Machine Learning & AI

Một trong những ứng dụng quan trọng nhất của Data Pipeline hiện đại chính là hỗ trợ AI và Machine Learning (ML). Thay vì chỉ phục vụ báo cáo truyền thống, pipeline còn đảm bảo dữ liệu được đưa vào mô hình học máy một cách liên tục, sạch và đáng tin cậy.

Cách hoạt động:

- Dữ liệu thô từ nhiều nguồn (bán hàng, thị trường, IoT, mạng xã hội) được pipeline thu thập và lưu vào Data Lake.

- Sau đó, dữ liệu được làm sạch và chuẩn hóa để đưa vào mô hình ML.

- Các pipeline tiên tiến hỗ trợ cả real-time data streaming. Nghĩa là mô hình có thể đưa ra dự đoán hoặc cảnh báo tức thời.

Ứng dụng:

- Dự đoán nhu cầu thị trường: Giúp doanh nghiệp tối ưu sản xuất và chuỗi cung ứng.

- Phát hiện gian lận: Ngân hàng, bảo hiểm dùng pipeline để giám sát giao dịch bất thường.

- Hệ thống gợi ý sản phẩm: Thương mại điện tử và bán lẻ cá nhân hóa trải nghiệm khách hàng.

Ví dụ thực tế:

Pipeline kết nối dữ liệu bán hàng (ERP) + dữ liệu thị trường (khảo sát, báo cáo Nielsen) → mô hình AI dự đoán nhu cầu sữa bột trẻ em trong 3 tháng tới. Dựa trên dự báo này, Vinamilk có thể điều chỉnh sản xuất, phân phối và chiến dịch marketing để tránh tình trạng dư thừa hay thiếu hàng.

Như vậy, Data Pipeline chính là “nguồn nhiên liệu sạch” cho AI/ML. Bởi mô hình chỉ tốt khi dữ liệu đầu vào chính xác và kịp thời.

V. Tạm kết

Hiểu về Data Pipeline là gì giúp bạn thấy rõ dữ liệu không chỉ đơn thuần là con số, mà là một dòng chảy xuyên suốt từ hệ thống vận hành đến phân tích và ra quyết định. Đây cũng chính là nền tảng để học hiệu quả các công cụ phân tích như Power BI hay các kỹ thuật phân tích kinh doanh.

Nếu bạn muốn đi từ lý thuyết đến thực hành, hãy bắt đầu với các khóa học phân tích dữ liệu tại ACE như Decision Analytics with Power BI và Data Analysis for Business Professionals – nơi bạn sẽ không chỉ học cách thao tác, mà còn rèn luyện tư duy phân tích dữ liệu chuẩn doanh nghiệp.

Excel và Power BI là 2 công cụ phổ biến được hầu hết các doanh nghiệp sử dụng hiện nay, đặc biệt là công cụ Power BI với các tính năng trực quan hóa dữ liệu ưu việt. Nếu bạn là newbie và muốn nhanh chóng thành thạo cả tư duy lẫn bộ kĩ năng phân tích và trực quan hóa dữ liệu trên Excel và Power BI, lộ trình này sẽ là một điểm khởi đầu hoàn hảo cho bạn.

Bên cạnh việc định hình tư duy và lộ trình phân tích dữ liệu chuẩn chỉnh, hoàn thành khóa học Decision Analytics with Power BI bạn sẽ có đầy đủ kỹ năng xử lí dữ liệu, xây dựng dashboard trên Power BI, phân tích chiến lược để tìm ra insight hữu ích, nâng cao thêm nhiều kĩ năng data storytelling, trực quan hóa và kể câu chuyện dữ liệu thú vị. Nếu bạn đang tìm kiếm khóa học với nhiều case study và project thực tế, đây cũng là sự lựa chọn tuyệt vời cho bạn.

VI. FAQ – Câu hỏi thường gặp về Data Pipeline

1. Data Pipeline là gì?

2. Data Pipeline có những loại nào?

3. Data Pipeline khác gì so với ETL?

4. Doanh nghiệp ứng dụng Data Pipeline để làm gì?

VII. Nguồn tham khảo

Bài viết dựa trên các khái niệm và cách tiếp cận phổ biến về kiến trúc Data Pipeline và best practice trong ngành.

- IBM – What is a Data Pipeline?

https://www.ibm.com/topics/data-pipeline - Google Cloud – Data Pipeline Basics

https://cloud.google.com/learn/what-is-data-pipeline - AWS – Data Pipeline Documentation

https://aws.amazon.com/datapipeline/ - Confluent – Introduction to Streaming Data Pipelines

https://www.confluent.io/learn/data-pipeline/ - Microsoft Azure – Data Integration & Pipeline Services

https://learn.microsoft.com/en-us/azure/data-factory/introduction-data-factory